如何在 Docker 上运行的 Apache Superset 中为电子邮件报告配置 Celery Worker 和 Beat?

Sno*_*now 6 python celery python-3.x docker apache-superset

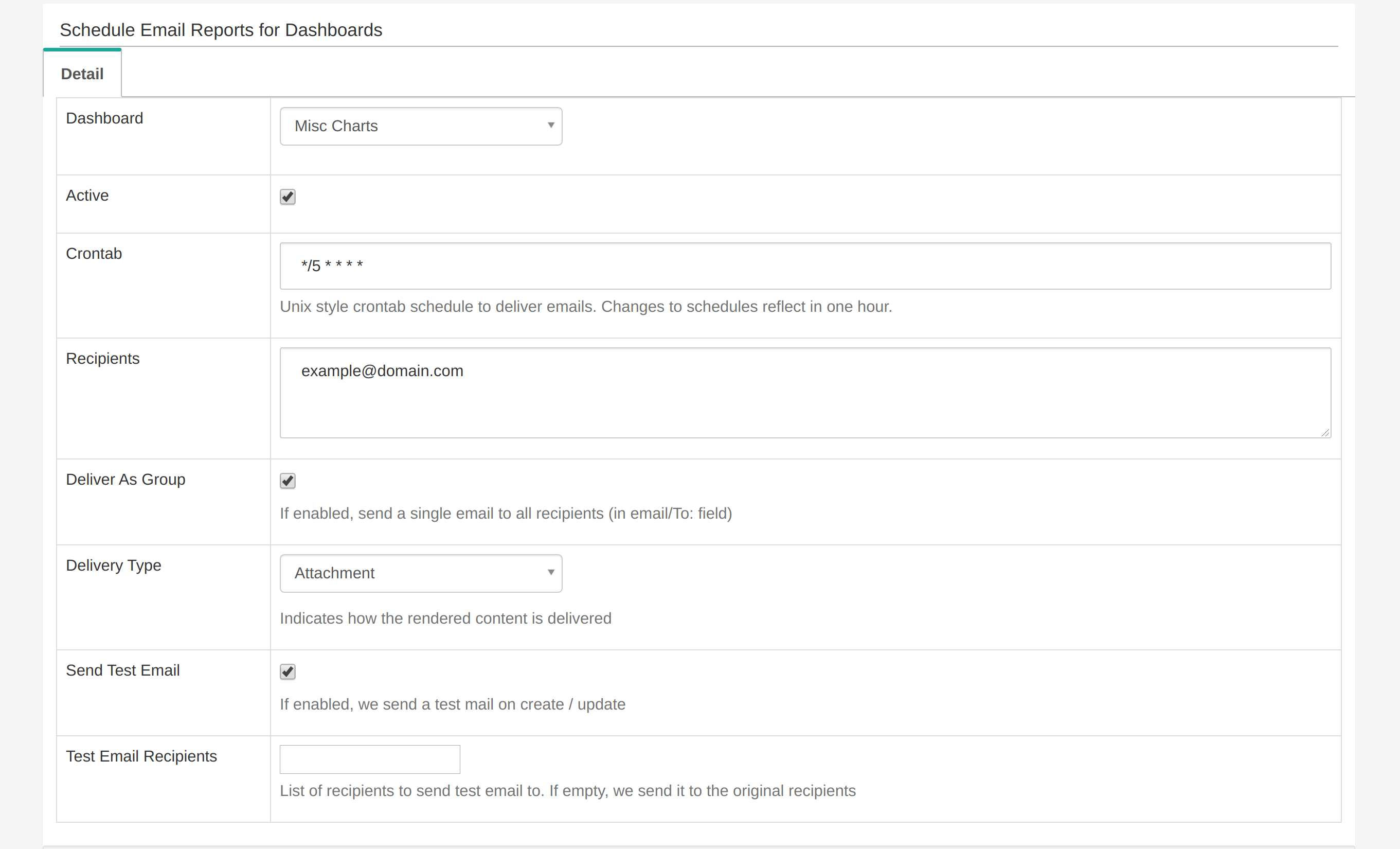

我正在通过 Docker 运行 Superset。我启用了电子邮件报告功能并尝试了它:

但是,我只收到测试电子邮件报告。之后我没有收到任何电子邮件。

这是我在 superset_config.py 中的 CeleryConfig:

class CeleryConfig(object):

BROKER_URL = 'sqla+postgresql://superset:superset@db:5432/superset'

CELERY_IMPORTS = (

'superset.sql_lab',

'superset.tasks',

)

CELERY_RESULT_BACKEND = 'db+postgresql://superset:superset@db:5432/superset'

CELERYD_LOG_LEVEL = 'DEBUG'

CELERYD_PREFETCH_MULTIPLIER = 10

CELERY_ACKS_LATE = True

CELERY_ANNOTATIONS = {

'sql_lab.get_sql_results': {

'rate_limit': '100/s',

},

'email_reports.send': {

'rate_limit': '1/s',

'time_limit': 120,

'soft_time_limit': 150,

'ignore_result': True,

},

}

CELERYBEAT_SCHEDULE = {

'email_reports.schedule_hourly': {

'task': 'email_reports.schedule_hourly',

'schedule': crontab(minute=1, hour='*'),

},

}

该文件说,我需要运行芹菜工人和节拍。

celery worker --app=superset.tasks.celery_app:app --pool=prefork -O fair -c 4

celery beat --app=superset.tasks.celery_app:app

我将它们添加到“ docker-compose.yml ”:

superset-worker:

build: *superset-build

command: >

sh -c "celery worker --app=superset.tasks.celery_app:app -Ofair -f /app/celery_worker.log &&

celery beat --app=superset.tasks.celery_app:app -f /app/celery_beat.log"

env_file: docker/.env

restart: unless-stopped

depends_on: *superset-depends-on

volumes: *superset-volumes

Celery Worker 在发送第一封电子邮件时确实在工作。日志文件也是可见的。但是,芹菜节拍似乎不起作用。也没有创建“celery_beat.log”。

如何正确配置 celery beat?我该如何调试?

CeleryConfig我设法通过改变实现并向“docker-compose.yml”添加节拍服务来解决这个问题

CeleryConfig“superset_config.py”中的新类:

REDIS_HOST = get_env_variable("REDIS_HOST")

REDIS_PORT = get_env_variable("REDIS_PORT")

class CeleryConfig(object):

BROKER_URL = "redis://%s:%s/0" % (REDIS_HOST, REDIS_PORT)

CELERY_IMPORTS = (

'superset.sql_lab',

'superset.tasks',

)

CELERY_RESULT_BACKEND = "redis://%s:%s/1" % (REDIS_HOST, REDIS_PORT)

CELERY_ANNOTATIONS = {

'sql_lab.get_sql_results': {

'rate_limit': '100/s',

},

'email_reports.send': {

'rate_limit': '1/s',

'time_limit': 120,

'soft_time_limit': 150,

'ignore_result': True,

},

}

CELERY_TASK_PROTOCOL = 1

CELERYBEAT_SCHEDULE = {

'email_reports.schedule_hourly': {

'task': 'email_reports.schedule_hourly',

'schedule': crontab(minute='1', hour='*'),

},

}

“docker-compose.yml”中的更改:

superset-worker:

build: *superset-build

command: ["celery", "worker", "--app=superset.tasks.celery_app:app", "-Ofair"]

env_file: docker/.env

restart: unless-stopped

depends_on: *superset-depends-on

volumes: *superset-volumes

superset-beat:

build: *superset-build

command: ["celery", "beat", "--app=superset.tasks.celery_app:app", "--pidfile=", "-f", "/app/celery_beat.log"]

env_file: docker/.env

restart: unless-stopped

depends_on: *superset-depends-on

volumes: *superset-volumes

| 归档时间: |

|

| 查看次数: |

2658 次 |

| 最近记录: |